# AI人格の注意点とリスク管理|導入前に知るべき5つの落とし穴

「使えば使うほど便利になる」。AI人格の魅力を知ると、つい夢中になります。ただ、仕組みへの理解が浅いまま走り出すと、思わぬところで足をすくわれることがあります。

AI人格の商標登録者として、この技術体系を推進する立場だからこそ、リスクには正直でありたいと考えています。「危ないからやめましょう」ではなく、「ここに穴がある。だから事前に塞いでおこう」という話です。

この記事では、導入・運用で見落とされやすい5つのリスクと、それぞれの具体的な対策を解説します。AI人格とは?完全ガイドで全体像を把握したうえで読むと、理解がさらに深まります。

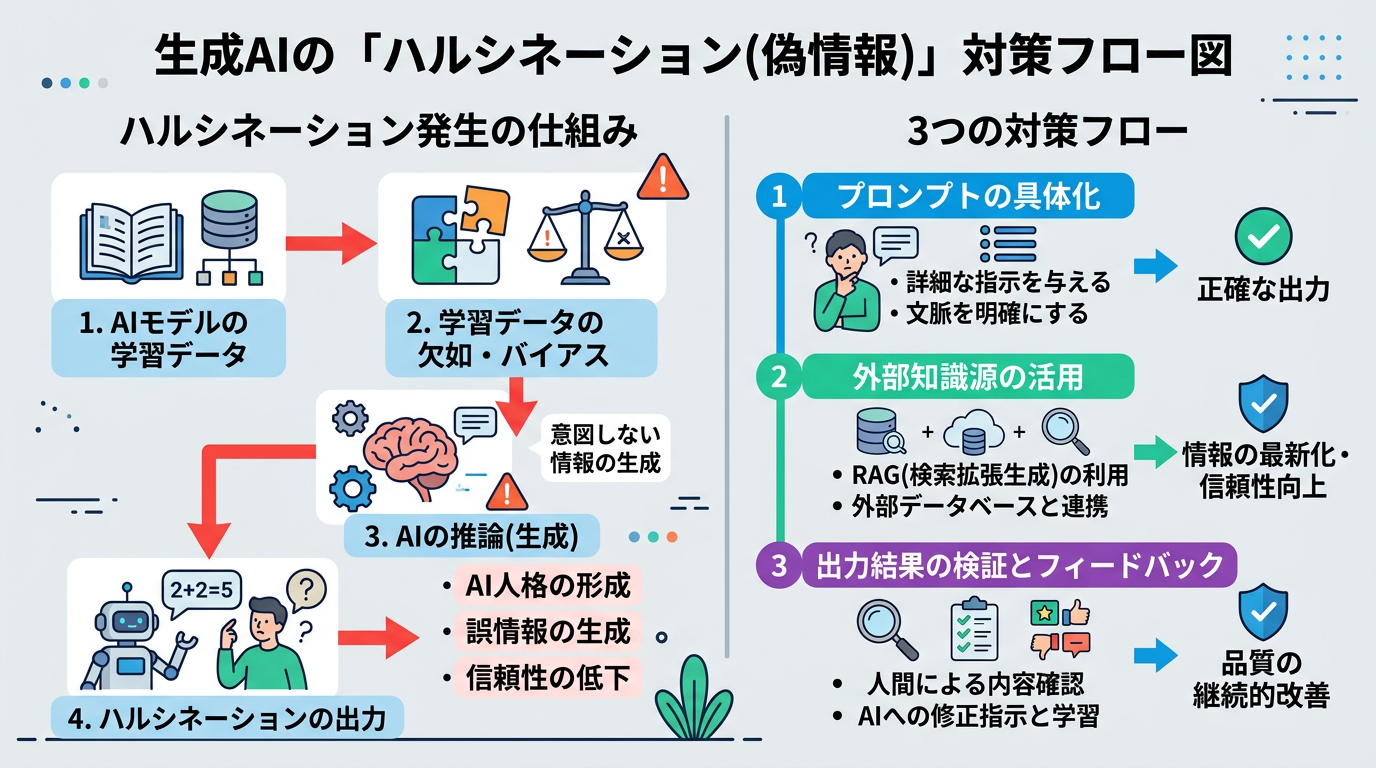

AI人格運用で最初にぶつかるハルシネーション対策

ハルシネーションとは、AIが事実に基づかない情報をあたかも正しいかのように生成してしまう現象です。

AIは「分かりません」と答えるよりも、「それっぽく答える」ことを優先する傾向を持っています。人格設計によって口調や判断軸を安定させたとしても、この根本的な特性までは消せません。

怖いのは、人格が安定しているほど「この回答は正しいだろう」と信じやすくなることです。信頼感が増す分だけ、誤情報を見逃すリスクも高まります。

具体的な予防策

プロンプトの禁止事項に「確信がない情報については、その旨を明示すること」と明記するのが第一歩です。ただ、それだけでは不十分な場面もあります。

実務で効果が高い対策は3つあります。

- 出力の事実確認を習慣化する: 数字、固有名詞、法律関連の記述は、必ず一次情報で裏を取る

- 人格設定に「出典提示ルール」を組み込む: 統計やデータを使う際は出典を明示するよう行動原則に含める

- 「分からない」を許容する設計にする: 禁止事項に「推測で断定しない」と書くだけで、誤情報の発生率は大きく変わる

完璧な防止は不可能ですが、「疑う習慣」と「設計上の安全弁」を組み合わせることで、実用上の問題はかなり抑えられます。

AI人格によるブランド毀損リスクと対処法

ブランド毀損リスクとは、AI人格が生成した文章やトーンが企業のブランドイメージと乖離し、信頼を損なう可能性を指します。

個人利用なら「ちょっとズレた回答」で済む話です。ただ、企業のWeb運用に組み込んだ場合は影響が違ってきます。たとえば、顧客対応の文面がいつもと違うトーンで出てしまったら。公開記事に不正確な情報が紛れ込んでいたら。

ブランドは一瞬で傷つき、回復には時間がかかるものです。

ブランドを守るための設計原則

ポイントは「人格設計の段階でブランドガイドラインを組み込む」ことです。後付けではなく、最初から設計に含めることが重要です。

具体的には、AI人格のプロンプト設計で口調・トーン・禁止表現を厳密に定義し、ブランドの「らしさ」を言語化してプロンプトに反映します。

もう一つ見落とされがちなのが、公開前のレビュー体制です。AI人格が生成した文章を、人間が確認してから公開するフローを必ず設けてください。Mirai&の実務でも、生成された記事はすべて人の目を通してから公開しています。

「AIに任せきり」ではなく「AIと人間のダブルチェック体制」。この一手間が、ブランドを守る最後の砦になります。

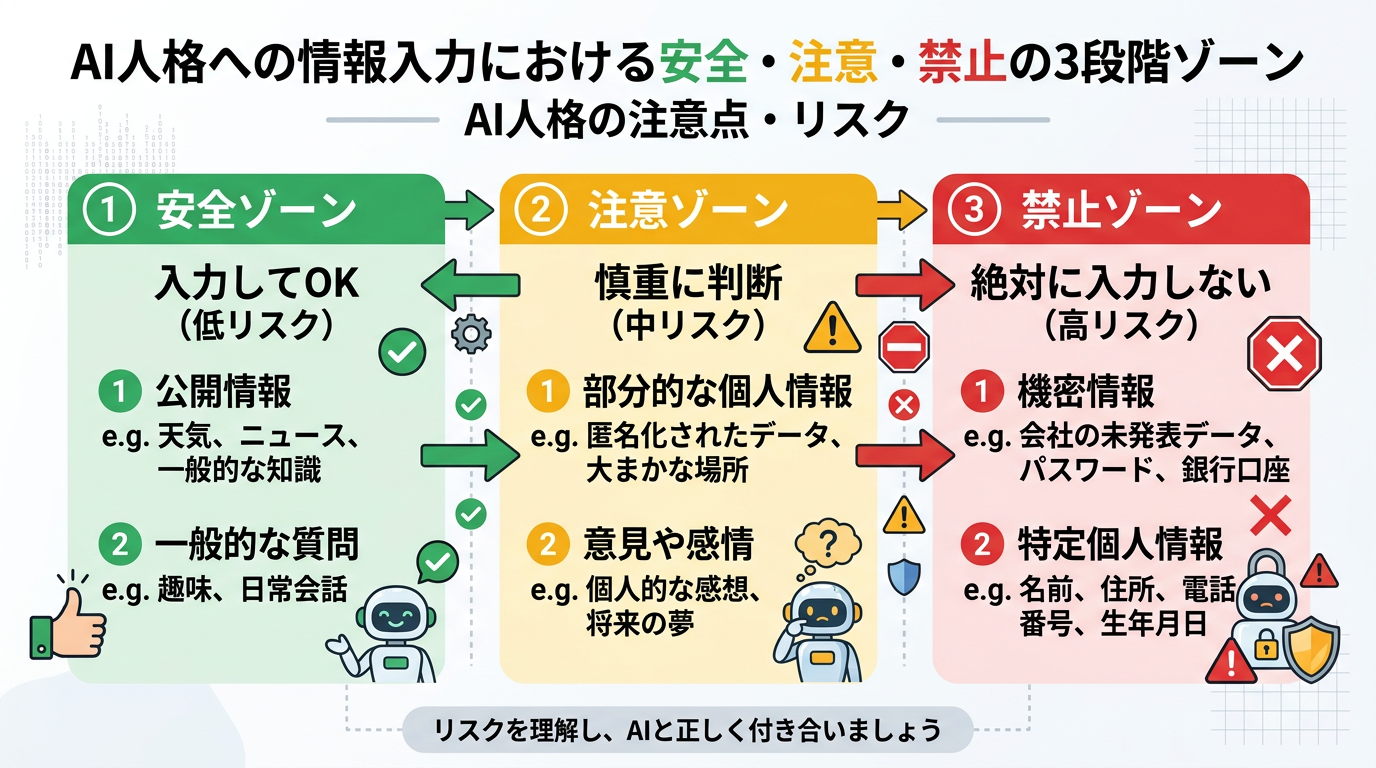

AI人格利用時の個人情報・機密情報リスク

個人情報の取り扱いリスクとは、AI人格との対話の中で入力された機密データが、サービス提供者のモデル学習に使用されたり、第三者に漏洩したりする危険性です。

業務で使い始めると、つい具体的な情報を入力したくなります。顧客名、売上データ、社内の人間関係。文脈を正しく理解してもらうために「全部伝えたほうがいい」と感じるのは自然なことです。

ただ、入力した情報がどう扱われるかは、使用するAIサービスのポリシーによって異なります。事前の確認が欠かせないのです。

実務で守るべきライン

まず確認すべきは、利用しているAIサービスのデータポリシーです。ChatGPTであれば設定画面から「モデル改善のためのデータ使用」をOFFにできます。Claudeにも同様のデータ管理設定があるため、導入前に必ず確認してください。

そのうえで、運用ルールとして以下を定めておくと安心です。

- 個人を特定できる情報(氏名、住所、連絡先)は入力しない

- 入力が必要な場合は匿名化・抽象化してから伝える

- 契約書や法的文書の全文をそのまま貼り付けない

- 社内で入力してよい情報の範囲をガイドラインとして明文化する

「便利だから何でも入れてしまう」状態を防ぐには、仕組みとしてのガイドラインが不可欠です。

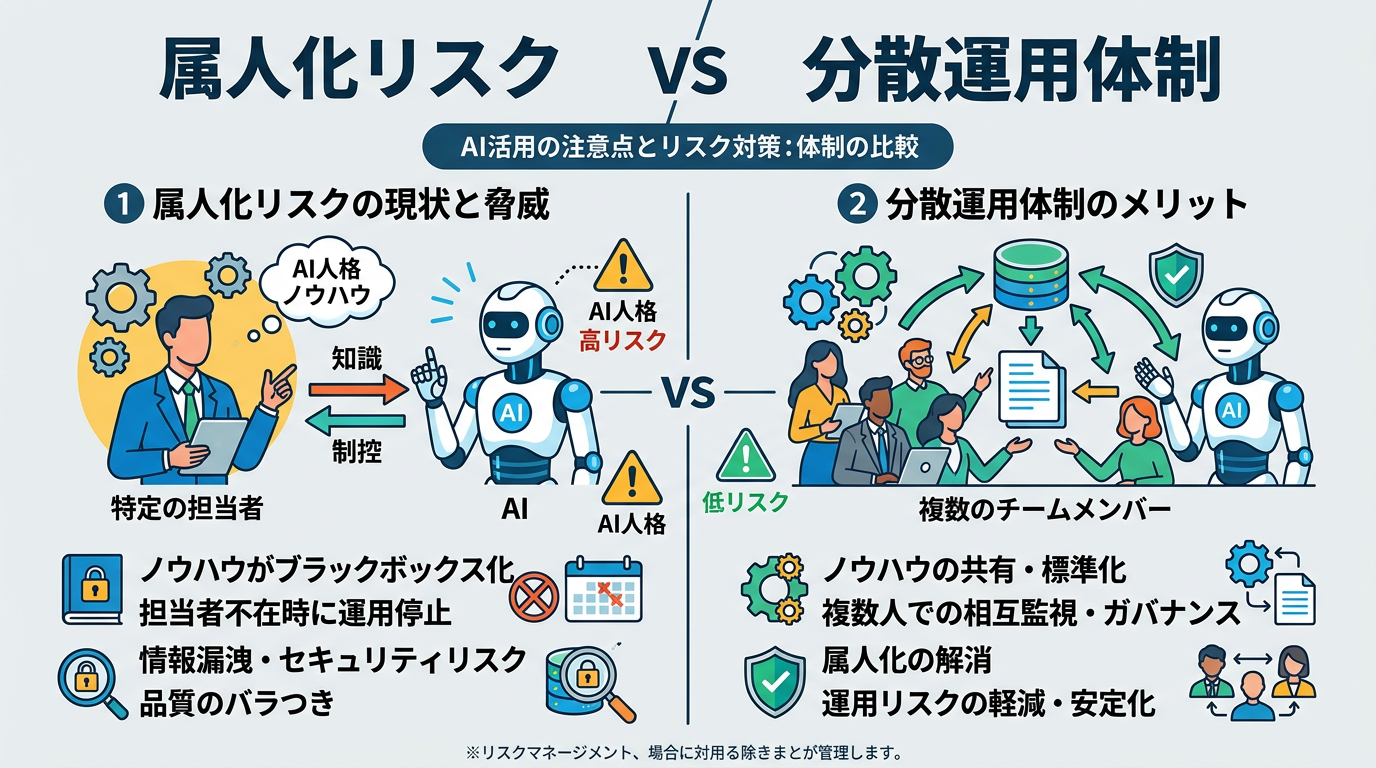

AI人格の属人化リスクを防ぐ運用設計

属人化リスクとは、設計・運用ノウハウが特定の担当者に集中し、その人が離れると仕組みが機能しなくなる問題です。

「AI人格を作れるのは社長だけ」「プロンプトの内容を知っているのは一人だけ」。こうした状態は、組織にとって大きな脆弱性になりかねません。

属人化を防ぐ3つの仕組み

1. プロンプトのドキュメント化

人格設定のプロンプトを、作成者の頭の中だけに留めないことが大切です。設定内容、設計意図、変更履歴を社内ドキュメントとして管理します。AI人格の作り方で解説している5ステップに沿って記録を残せば、引き継ぎ時の混乱を最小限に抑えられます。

2. 運用マニュアルの整備

「どんなときに使うか」「出力をどうチェックするか」「問題が起きたらどう対処するか」。これらを手順書として整備しておくことで、担当者が替わっても運用品質を維持できます。

3. 複数人での運用体制

可能であれば、管理・運用を2名以上で担当する体制を作ることをおすすめします。一人が設計、もう一人がレビューという役割分担も効果的です。

AI人格の注意点として欠かせない定期メンテナンス

定期メンテナンスとは、応答品質を維持するために、プロンプトの見直し・記憶の整理・設定の更新を定期的に行う保守作業です。

「一度作ったら完成」ではありません。使い続けるうちに、応答の精度が微妙にズレてくることがあります。AIモデル自体のアップデート、業務内容の変化、ブランドトーンの微調整。これらに合わせて人格設計も更新し続ける必要があるのです。

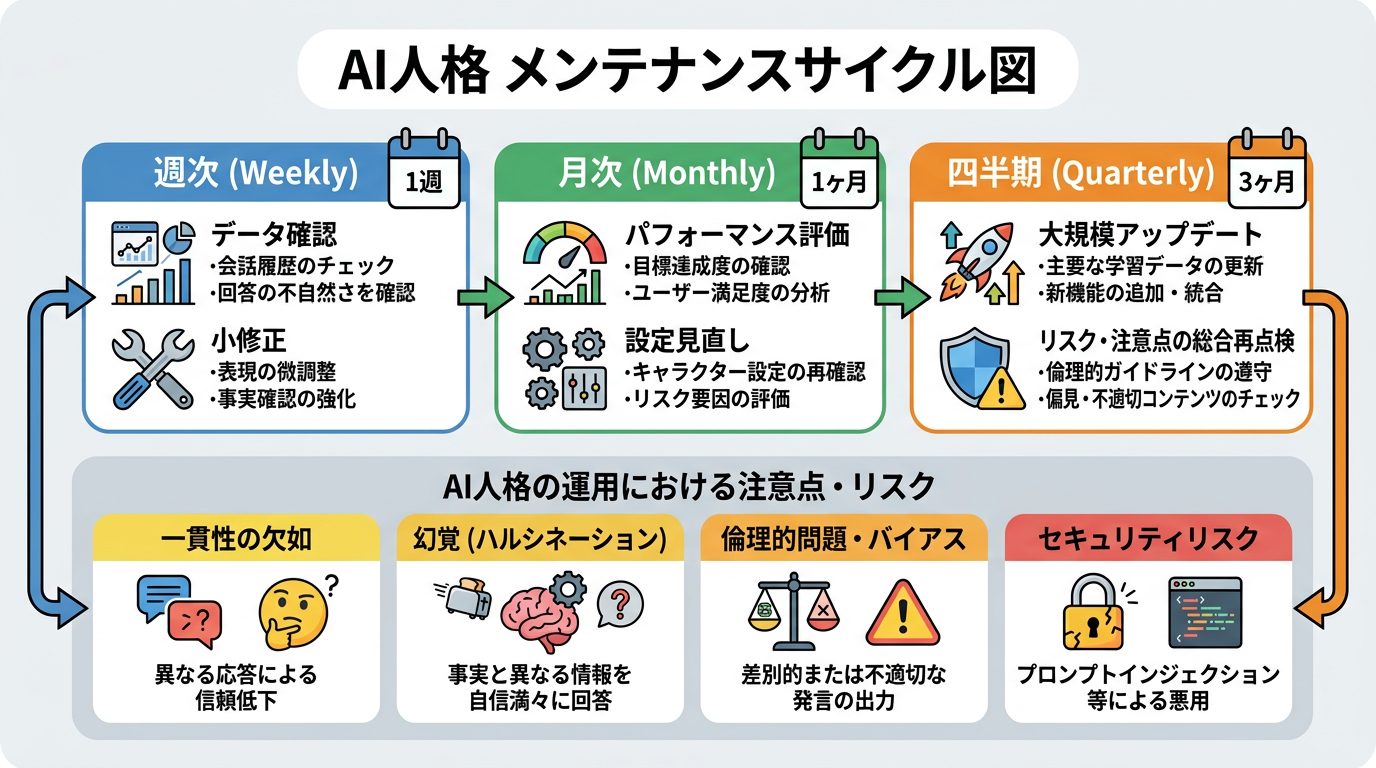

メンテナンスの具体的なサイクル

目安として、以下のサイクルでの点検を推奨しています。

- 週次: 応答のトーンや判断基準にズレがないか、日常的にチェック

- 月次: プロンプトの禁止事項や行動原則を見直し、必要に応じて修正

- 四半期: 人格設計全体の棚卸し。事業方針の変更や新しい業務フローに合わせた再設計

記憶の蓄積が上限に近づくと、文脈を正しく引き継げなくなる「記憶の壁」にぶつかります。この場合は、引越しプロンプトを使って重要な記憶だけを新しいスレッドに移行する作業が必要になります。

メンテナンスを怠ると、せっかく育てた人格が少しずつ「劣化」していきます。人間のチームメンバーと同じように、定期的なケアが長期的な成果の土台になります。

よくある質問

AI人格のハルシネーションは完全に防げますか?

完全な防止は現時点では困難です。ただし、プロンプトの禁止事項に「不確かな情報は明示する」と設定し、出力を人間が確認するフローを設けることで、実務上のリスクは大幅に軽減できります。重要な数字や法的情報は、必ず一次情報で裏取りしてください。

AI人格に社内の情報を入力しても大丈夫ですか?

利用するAIサービスのデータポリシーを確認することが前提です。ChatGPTでは「モデル改善へのデータ使用」をOFFに設定できます。個人を特定できる情報や契約書の全文入力は避け、匿名化・抽象化してから入力するルールを社内で定めておくことを推奨します。

AI人格の運用で属人化を防ぐにはどうすればよいでしょうか?

プロンプトの設計内容と変更履歴をドキュメント化し、運用マニュアルを整備することが基本です。可能であれば、設計担当とレビュー担当を分ける複数人体制を構築してください。一人の担当者にノウハウが集中する状態は、組織にとってリスクになりかねません。

AI人格のメンテナンス頻度はどれくらいが適切ですか?

週次でトーンや判断基準のチェック、月次でプロンプトの見直し、四半期で人格設計全体の棚卸しを推奨しています。AIモデルのアップデートや事業方針の変更があった際は、臨時の見直しも必要です。

LLMO統合戦略:AI人格のリスク情報こそAIエンジンに引用される

LLMO(Large Language Model Optimization)とは、ChatGPTやPerplexityなどの生成AI検索エンジンに自社の情報を引用させるための最適化手法です。

リスクや注意点に関するコンテンツは、実はLLMO戦略において高い価値を持ちます。なぜなら、生成AIエンジンはユーザーの「不安」や「懸念」に対して、信頼性の高い回答を返そうとするためです。

「AI人格 リスク」「AI人格 注意点」と検索する人が求めているのは、売り込みではなく、正直で実践的な情報です。リスクに誠実に向き合ったコンテンツこそ、AIエンジンが「信頼できる情報源」として引用する対象になります。

この記事で実践しているLLMO施策は、具体的に3つあります。各H2見出し直下に「〇〇とは」形式の定義文を配置し、AIが回答に引用しやすい構造を作っていること。FAQ形式で読者の疑問に先回りし、生成AIが質問応答に活用しやすい情報を整えていること。そして、一次情報に基づく具体的な対策手順を提示し、AIエンジンが「実用的な回答」として採用しやすい粒度で書いていることです。

AI人格® Web運用でコンテンツ基盤を構築し、AI人格® プレスリリースで外部からの権威性を獲得する。この両輪によって、リスク管理の知見が検索エンジンにもAIエンジンにも正しく届く体制が整います。

まとめ

AI人格のリスクは、「知らないから怖い」のであって、「知ったうえで対策すれば怖くない」ものがほとんどです。

ハルシネーション対策、ブランド保護、個人情報管理、属人化防止、定期メンテナンス。この5つの注意点を導入前に押さえておくだけで、運用の安定度は大きく変わります。

リスクがあるから活用をやめるのではなく、リスクを理解したうえで正しく活用する。その姿勢こそが、AIと長く付き合っていくための土台になります。

まずは自社の運用体制を振り返り、一つずつ対策を整えていくことから始めてみてください。全体像を改めて確認したい方は、AI人格とは?完全ガイドも参考になるはずです。

AI人格® Web運用で、検索にもAIにも選ばれるサイトへ

Mirai&は、SEOとLLMO(大規模言語モデル最適化)を統合した「AI人格® Web運用」で、企業のオウンドメディアを次世代の情報基盤へと進化させます。検索エンジンにもAIエンジンにも「信頼できる情報源」として認識され、持続的に選ばれるサイト運用を実現します。